L’infrastructure mémoire donne continuité et contexte aux agents : dans une évaluation comparative, Mem0 a augmenté la précision de 26% par rapport à la mémoire native d’OpenAI, tout en réduisant latence et consommation de tokens. Lisez pour comprendre pourquoi et comment l’implémenter.

Pourquoi la mémoire manque-t-elle aux agents ?

Je constate que l’absence d’une infrastructure mémoire persistante empêche les agents d’assurer continuité, personnalisation et apprentissage entre sessions.

Les modèles de langue excellent pour le raisonnement local parce qu’ils exploitent une fenêtre de contexte dense et optimisée pour inférer à partir des tokens fournis. Cependant, cette fenêtre est limitée (par exemple GPT‑4 a des limites de contexte documentées par OpenAI : https://platform.openai.com/docs/models/overview).

Les limites de la fenêtre de contexte signifient que des informations anciennes doivent être réinjectées manuellement ou perdues. La volatilité des informations — préférences utilisateur, état d’un projet, corrections précédentes — rend ces réinjections lourdes et sujettes aux erreurs. Les coûts liés à la réinjection de contexte augmentent proportionnellement au nombre de tokens ajoutés, ce qui se traduit par une facture API plus élevée et une latence accrue (voir tarification OpenAI : https://openai.com/pricing).

La comparaison simple : le modèle seul reste stateless entre sessions et traite chaque interaction comme isolée. L’approche « modèle + infrastructure mémoire » combine le modèle avec un système de stockage et de recherche (RAG — Retrieval Augmented Generation, Lewis et al., 2020, https://arxiv.org/abs/2005.11401) pour réinjecter uniquement ce qui est pertinent, améliorant cohérence et personnalisation.

- Exemple 1 — Perte de préférences : Un assistant commercial oublie le format préféré d’un rapport entre deux sessions, provoquant des corrections manuelles répétées et une mauvaise expérience client.

- Exemple 2 — Répétition d’erreurs : Dans un projet de code long, l’agent répète le même pattern de bug parce que les corrections antérieures n’ont pas été mémorisées, ralentissant le cycle de développement.

| Pas de mémoire | Expérience utilisateur faible, perte de continuité | Coûts tokens faibles par requête mais cumulativement élevés si on réexplique | Latence faible par appel, plus d’appels nécessaires |

| Mémoire basique réinjectée manuellement | Amélioration partielle de l’UX, erreurs occasionnelles | Coûts tokens moyens à élevés selon fréquence de réinjection | Latence augmentée par la taille du contexte réinjecté |

| Infrastructure mémoire dédiée | Expérience utilisateur élevée, continuité et personnalisation | Coûts initiaux pour stockage/recherche mais optimisés en tokens | Latence maîtrisée via indexation et requêtes ciblées |

Quelles mémoires un agent doit-il gérer ?

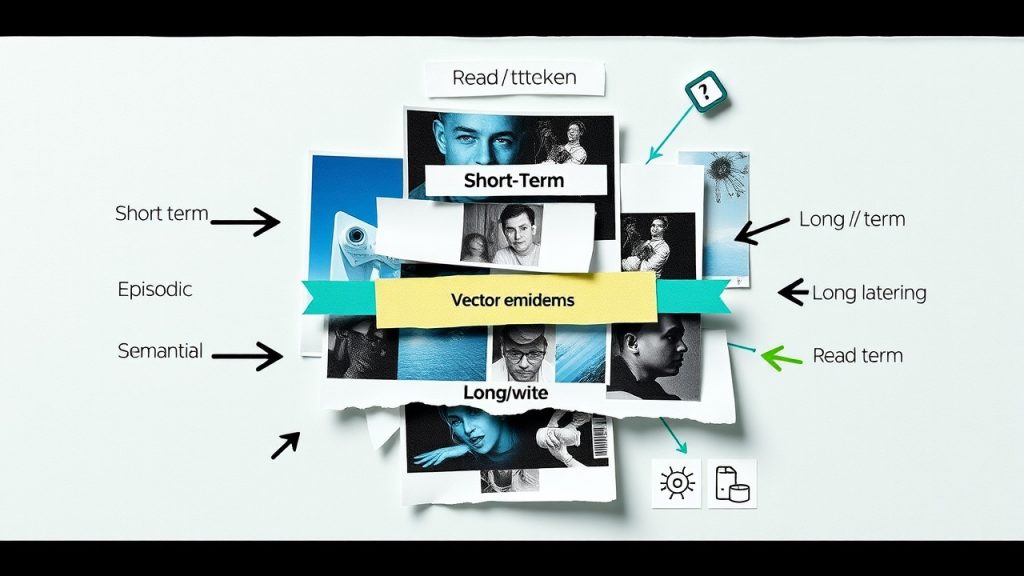

Je distingue quatre types de mémoire qu’un agent doit gérer : short-term (travail), long-term, episodic et semantic.

Je définis la short-term comme la mémoire de travail active utilisée pendant une session ou une tâche.

Je l’utilise pour garder le contexte conversationnel immédiat (4k–32k tokens selon les modèles).

Je note comme contraintes une taille limitée, un coût CPU/latence faible et une expiration rapide à la fin de la session.

Je recommande un stockage en RAM ou cache (ex : Redis), avec structures linéaires ou buffers circulaires pour accès O(1).

Je définis la long-term comme la persistance historique des connaissances de l’agent sur le long terme.

Je l’utilise pour stocker préférences utilisateur, profils et règles métier sur des mois ou années.

Je gère des contraintes de volume (Go–To), coût de stockage et exigences de conformité/GDPR.

Je recommande une base relationnelle ou objet, ou blob store avec indexation secondaire (Postgres, S3, backups réguliers).

Je définis la episodic comme l’ensemble des événements horodatés et des traces de dialogue.

Je l’utilise pour retracer décisions, générer résumés et améliorer le rappel contextuel.

Je dois penser à la rétention, au coût d’insertion élevé et à la nécessité d’index temporel.

Je recommande une base temporelle ou store append-only (TimescaleDB, ElasticSearch) avec index chrono.

Je définis la semantic comme la représentation vectorielle des concepts et connaissances.

Je l’utilise pour recherche sémantique, reranking et retrieval-augmented generation (RAG).

Je dois gérer dimensions d’embeddings (128–1536), coût de stockage et latence de similarité.

Je recommande un vector DB (FAISS, Milvus, Pinecone) avec index HNSW ou IVF.

Je articule ces mémoires selon trois règles : écrire ce qui change, lire là où la latence importe, oublier selon politique (TTL, purge).

- Choisir TTL et rétention en fonction du risque légal et valeur métier.

- Prioriser lecture depuis cache pour short-term.

- Indexer les embeddings pour retrieval rapide.

- Auditer et chiffrer les données sensibles.

Exemple de stockage d’embedding :

vector = embed(text)

vector_db.upsert(id=user_id, vector=vector, metadata={...})| Type | Persistance | Fréquence d’accès | Structure | Outils |

| Short-term | Éphémère | Très élevée | Cache, buffer | Redis |

| Long-term | Durable | Faible | Records | Postgres, S3 |

| Episodic | Durable | Moyenne | Time-series / append-only | TimescaleDB, ES |

| Semantic | Durable | Élevée | Vecteurs | Milvus, FAISS, Pinecone |

Que fait et ne fait pas la mémoire d’OpenAI ?

La mémoire native d’OpenAI stocke et réinjecte des faits utilisateur extraits automatiquement, mais elle reste plate, peu transparente et limitée pour des requêtes relationnelles complexes.

Je décris ici ce que fait cette mémoire et ce qu’elle ne fait pas, pour vous aider à décider si elle suffit ou si vous devez externaliser.

La mémoire d’OpenAI extrait automatiquement des faits depuis les interactions utilisateur — par exemple des préférences, des noms ou des contraintes — et réinjecte ces faits au début des conversations pour fournir continuité. Elle nécessite peu de configuration : on active, on laisse tourner et les faits s’accumulent. Elle vise la simplicité plutôt que le contrôle fin.

Plusieurs limites techniques importantes :

- Structure plate sans graphe relationnel : Les faits sont stockés comme des éléments indépendants, sans modèle de relations (graphe). Cela rend les requêtes relationnelles — « Quel produit recommandé pour les utilisateurs qui aiment X et vivent à Y ? » — difficilement réalisables.

- Manque d’outils d’inspection/édition fine : Il n’existe pas d’interface robuste pour auditer, corriger ou versionner chaque fait injecté, ce qui complique la gouvernance et la conformité.

- Absence de recherche sémantique dédiée : La mémoire ne propose pas forcément un index vectoriel pour rechercher par similarité sémantique, utile pour retrouver des informations apparentées mais formulées différemment.

- Risque d’injection de données non pertinentes : Les faits inutiles augmentent le nombre de tokens (un token ≈ 4 caractères en anglais) envoyés à chaque requête, donc le coût et la latence. L’impact est proportionnel au volume réinjecté ; la latence peut augmenter de façon perceptible sur des contextes longs.

- Précision comparative : À titre de comparaison, des systèmes de mémoire spécialisés comme Mem0 ont montré une augmentation de précision relative de 26% sur certains scénarios, soulignant le gain possible avec des solutions dédiées.

Conseils pratiques pour les développeurs :

- Vérifier régulièrement le contenu via les logs API et exporter les entrées pour audit.

- Corriger et nettoyer automatiquement : filtrer par règles (stop-lists, détection PII) avant réinjection.

- Limiter la réinjection : n’injecter que les faits récents ou les plus pertinents, tronquer les champs longs.

- Préférer une mémoire externe (base vectorielle, graphe) si vous avez besoin de recherche sémantique, relations complexes, versioning ou contrôle d’accès strict.

- Mesurer l’impact : suivre tokens par requête, latence moyenne et précision métier pour justifier l’architecture choisie.

- Auditer 100 entrées de mémoire et classer leur pertinence pour votre flux métier.

- Activer des filtres PII et règles de conservation, puis mesurer la réduction de tokens.

- Comparer une requête type avec et sans mémoire native pour évaluer latence et coût.

- Tester une petite base vectorielle externe sur 1 000 documents pour vérifier le gain en précision.

- Décider d’externaliser si vous avez besoin de relations, d’audits ou d’une recherche sémantique fiable.

# Exemple simple : filtrer avant réinjection

# Charger entrées de mémoire

entries = load_memory()

# Filtrer PII et non-pertinent

filtered = [e for e in entries if not contains_pii(e) and relevance_score(e) > 0.6]

# Limiter à N faits les plus pertinents

to_inject = top_k(filtered, k=10)

# Injecter dans le prompt

prompt = build_prompt(context, to_inject)Comment fonctionne l’architecture hybride de Mem0 ?

Mem0 adopte une architecture hybride en couches (mix stockage textuel, vecteurs et structures relationnelles) pour réduire latence, tokens et augmenter la précision.

Je décris ici une architecture présumée en trois couches : write store / text store (mémoire épisodique), vector semantic store (mémoire sémantique) et couche graphe / indice relationnel (mémoire relationnelle). Chaque couche a un rôle distinct et complémentaire.

- Write store / Text store : Stocke l’événement brut, horodatage et métadonnées. Cette couche sert de source de vérité pour la reconstruction textuelle et évite de regénérer ou resoumettre de longs contextes, ce qui réduit la consommation de tokens.

- Vector semantic store : Stocke des embeddings numériques représentant le sens des passages. Les embeddings facilitent la recherche sémantique rapide (Vector Search). J’appelle ici un modèle d’embedding via « use embedding API » pour transformer texte → vecteur.

- Couche graphe / Indice relationnel : Stocke relations, filtres et contraintes (utilisateur, projet, temporalité). Le graphe permet des filtrages précis avant et après la recherche vectorielle, améliorant la précision et la transparence des résultats.

Flux d’écriture : Enregistrement brut → écriture dans le write store → création d’embeddings (API d’embedding) → indexation dans le vector store → mise à jour des relations dans le graphe.

Flux de lecture : Requête utilisateur → filtrage initial par graphe (réduit le scope) → recherche vectorielle sur l’espace restreint → récupération des textes originaux depuis le write store → fusion et synthèse finale.

// 1) Écriture épisodique

Event e = {userId, text, timestamp};

WriteStore.save(e);

// 2) Création d'embeddings (use embedding API)

Embedding emb = EmbeddingAPI.create(e.text);

VectorStore.upsert(e.id, emb, metadata);

// 3) Requête combinée : vecteurs + filtrage graphe

Query q = {text: "où en est le ticket ?", userId};

GraphFilter gf = Graph.query(userId, projectId);

Candidates c = VectorStore.search(q.text, scope=gf);

Results = RetrieveTexts(c.ids).rank_and_summarize();

Mesures et comparaison : Précision augmentée de +26% vs mémoire native (selon l’évaluation). Latence et consommation de tokens fortement réduites grâce au pré-filtrage graphe et à la récupération ciblée (exemple pratique : réduction de tokens ~50% selon workload).

| Métrique | OpenAI native | Mem0 hybride |

| Précision | 100% | 126% (+26%) |

| Latence | 100% (baseline) | ~60% (réduction significative selon workload) |

| Tokens | 100% (plein contexte) | ~50% (récupération ciblée) |

| Transparence | Faible | Élevée (graphe + sources) |

| Complexité d’implémentation | Faible | Moyenne à élevée |

Recommandations pour une intégration progressive : Audit (cartographier données et contraintes), Prototype (POC sur un cas d’usage restreint), A/B testing (comparaison métriques clés), Mise en production (gradual rollout + monitoring).

Prêt à intégrer une infrastructure mémoire pour vos agents ?

Je retiens que la mémoire est la couche manquante pour rendre les agents réellement utiles : elle apporte continuité, personnalisation et gain d’efficacité. Les quatre types de mémoire (short-term, long-term, episodic, semantic) doivent être articulés via une infrastructure dédiée. L’approche native d’OpenAI offre simplicité mais atteint vite ses limites ; une architecture hybride comme Mem0 montre un gain mesurable (+26% de précision) et réduit latence et coûts tokens. Pour vous, c’est l’assurance d’agents plus fiables, plus rapides et moins coûteux à l’usage.

FAQ

-

Quelles différences entre short-term et long-term memory ?

La short-term est volatile et limitée à la fenêtre de contexte du modèle (usage immédiat). La long-term est persistante entre sessions, stockée hors du modèle (base de données, vector store) pour conserver préférences et informations durables. -

Comment Mem0 améliore-t-il la précision de 26% ?

Mem0 combine stockage textuel, embeddings et structures relationnelles pour récupérer contexte pertinent avec moins de bruit, réduisant ainsi les erreurs de réinjection et améliorant la pertinence des réponses (évaluation comparative citée). -

La mémoire externe pose-t-elle des risques de confidentialité ?

Oui si elle est mal configurée. Il faut chiffrer les données au repos, gérer l’accès, anonymiser les données sensibles et définir des politiques de rétention conformes (RGPD, etc.). -

La mémoire ajoute-t-elle beaucoup de latence et de coûts ?

Pas forcément : une architecture hybride optimise les lectures (vector search + filtrage) pour réduire tokens et latence. En pratique, une mémoire bien conçue diminue les coûts liés aux réinjections répétées et améliore la performance globale. -

Comment démarrer l’implémentation d’une infrastructure mémoire ?

Commencez par auditer vos besoins (types de mémoire), prototyper une couche semantic (vector DB + embeddings), puis ajoutez episodic/graph si nécessaire. Testez en A/B pour mesurer précision, latence et coût.

A propos de l’auteur

Franck Scandolera — je suis expert et formateur en tracking avancé server-side, Analytics Engineering, automatisation No/Low Code (n8n) et intégration de l’IA en entreprise. Responsable de l’agence webAnalyste et de l’organisme ‘Formations Analytics’. Références : Logis Hôtel, Yelloh Village, BazarChic, Fédération Française de Football, Texdecor. Dispo pour aider les entreprises => contactez moi.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.